指南

🦞 分析让代理反馈闭环真正成立

AI 系统之所以能改进,是因为动作和结果之间保持了连接。分析就是告诉代理‘发布之后发生了什么’的那一层。

你的代理改了一个 headline,发了部署,然后给你发消息:

“Shipped.”

很好。但注册量有提升吗?CTA 点得更多了吗?留存变好了还是只是吸引来了错误的用户?

如果代理回答不了这些问题,它就没有完成反馈闭环。它只是完成了一个任务。

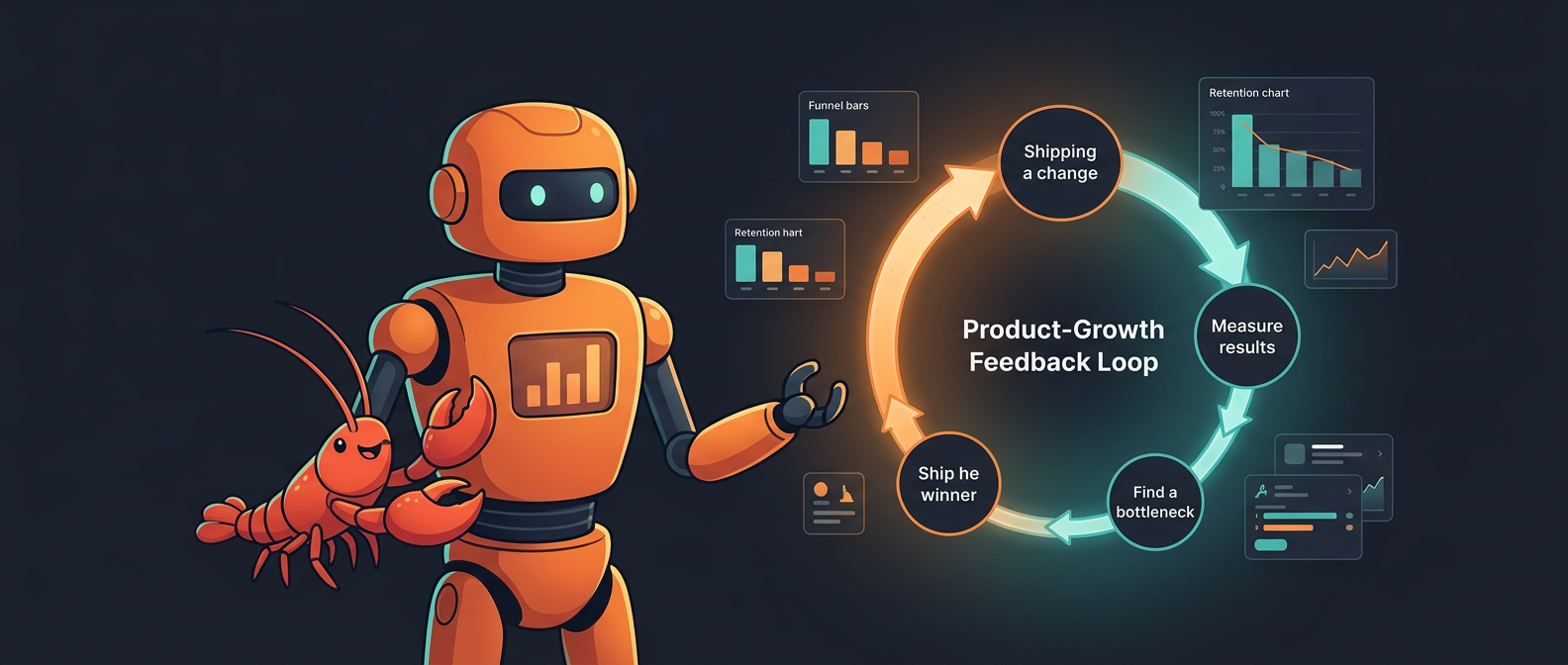

AI 代理需要更短的反馈闭环

一个有用的闭环只有三个步骤:

- 执行动作:改页面、改 onboarding、改某个 flow

- 观察结果:流量、点击、注册、留存、实验结果

- 更新下一步动作:继续、停止、测试、迭代

如果缺少“观察结果”,代理就是在盲飞。

大多数代理工作流断在哪里

很多代理演示只展示到“代码写完了”或“PR 开了”。

但真正的问题是:部署之后发生了什么?

多数分析工具假设会有一个人去打开 dashboard、点击筛选器、做报表、再决定下一步。对于代理来说,这一步正是断点。

代理需要的是 结构化的 outcome signal,而不是一张截图。

分析就是 outcome signal

这也是为什么在代理时代,分析变得更重要。

- Stats 告诉代理:改动到底有没有带来变化

- Funnels 告诉代理:用户卡在哪一步

- Retention 告诉代理:改动是不是能长期成立

- Experiments 告诉代理:哪个变体赢了

- Breakdowns 告诉代理:是哪一类用户、页面、来源或设备推动了变化

这不是在观察代理本身,而是在观察产品结果。

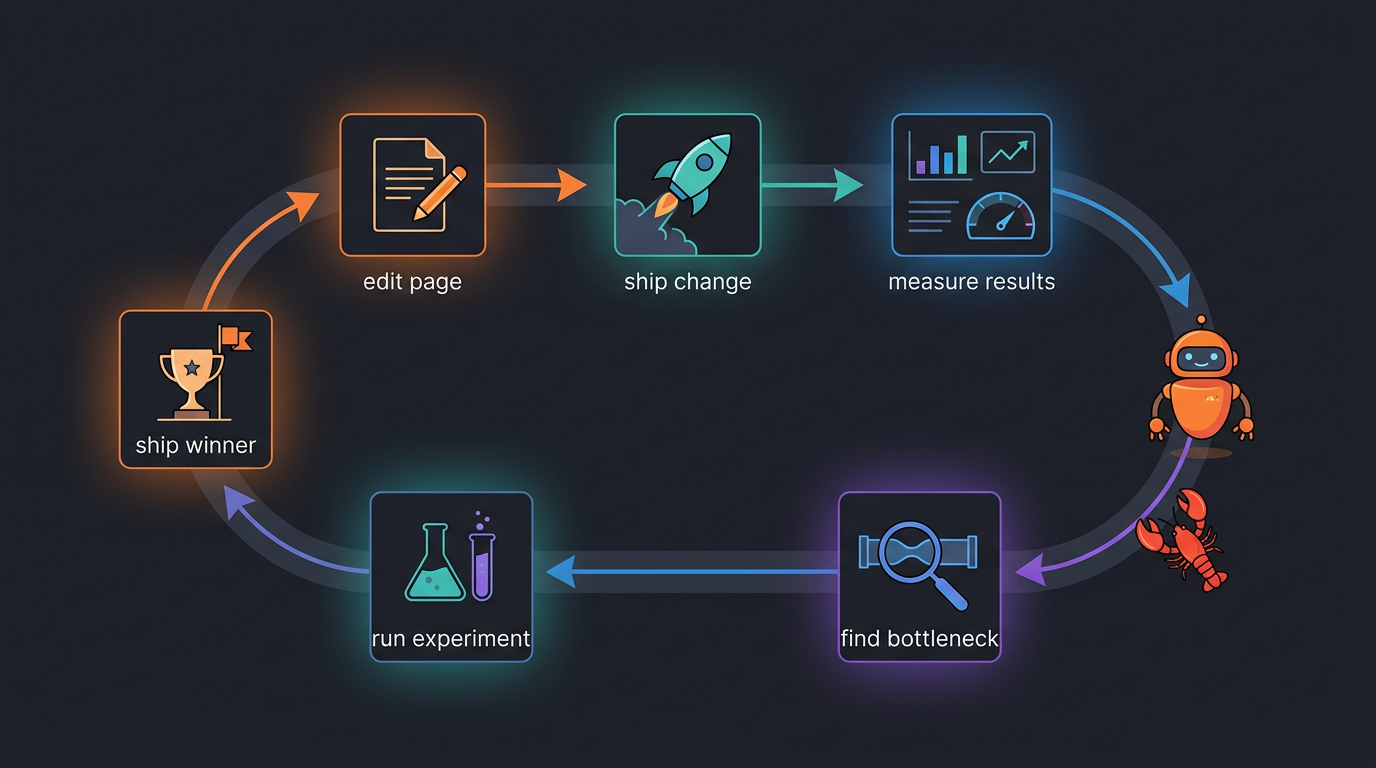

闭环应该长什么样

- 代理修改落地页

- 代理发布改动

- 代理测量结果

- 代理识别 bottleneck

- 代理创建实验

- 代理再次测量并继续迭代

重点是:测量环节留在了 workflow 里,而不是依赖人类“之后记得打开 dashboard 看一下”。

为什么单独的仪表盘会打断闭环

仪表盘对人类没问题,但对自主系统来说摩擦太大。

它默认某个人会:

- 记得打开它

- 想清楚该问什么

- 点对正确的筛选器

- 手动解释结果

- 再把结论喂回下一次决策

代理需要的是相反的东西:

- 低延迟访问

- 结构化输出

- 可重复执行的查询

- 与真实目标绑定的成功/失败信号

这会解锁什么

一旦代理能直接测量 outcome,它就不再只是一个写代码的工具,而开始像一个 operator。

它可以:

- 每天早上检查项目并告诉你哪里变了

- 持续监控 funnels

- 比较渠道质量

- 运行实验并推荐赢家

- 不只告诉你“发生了什么”,还告诉你“下一步该做什么”

这才是真正有价值的升级。